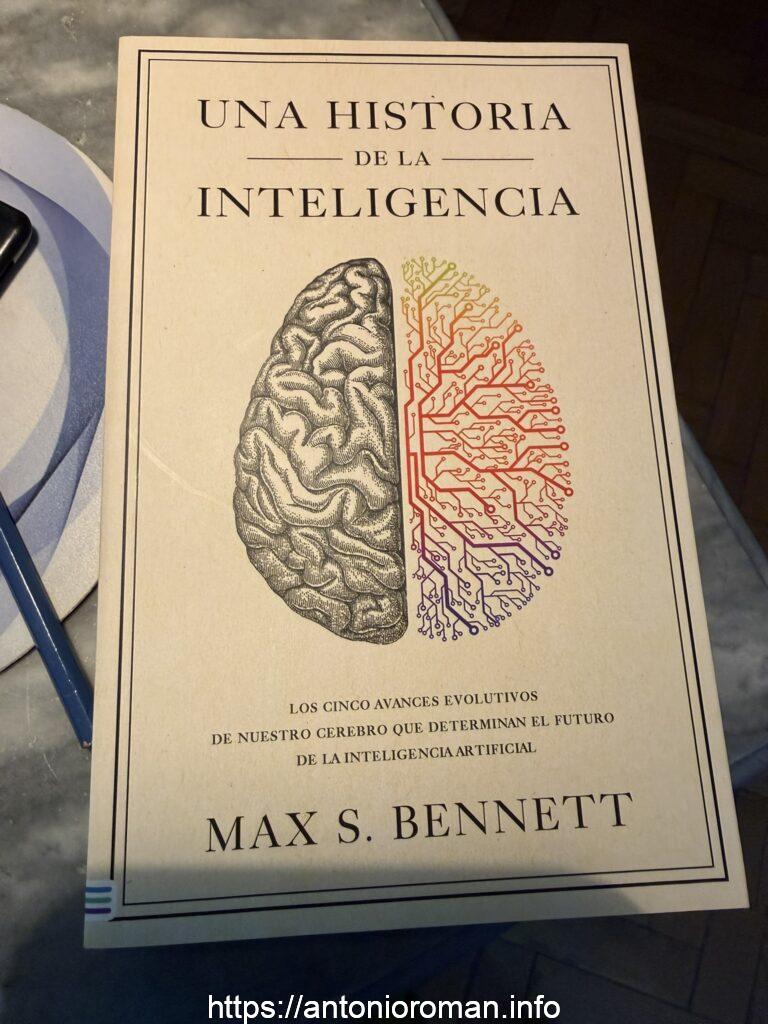

Hay preguntas tan simples que parecen imposibles de responder mal. Y, sin embargo, millones de personas caen sistemáticamente en el mismo error. Daniel Kahneman lo demostró mediante un experimento clásico de psicología cognitiva que se transformó en uno de los ejemplos más conocidos sobre el funcionamiento de la mente humana (Bennett, M. S., 2025, pág. 25).

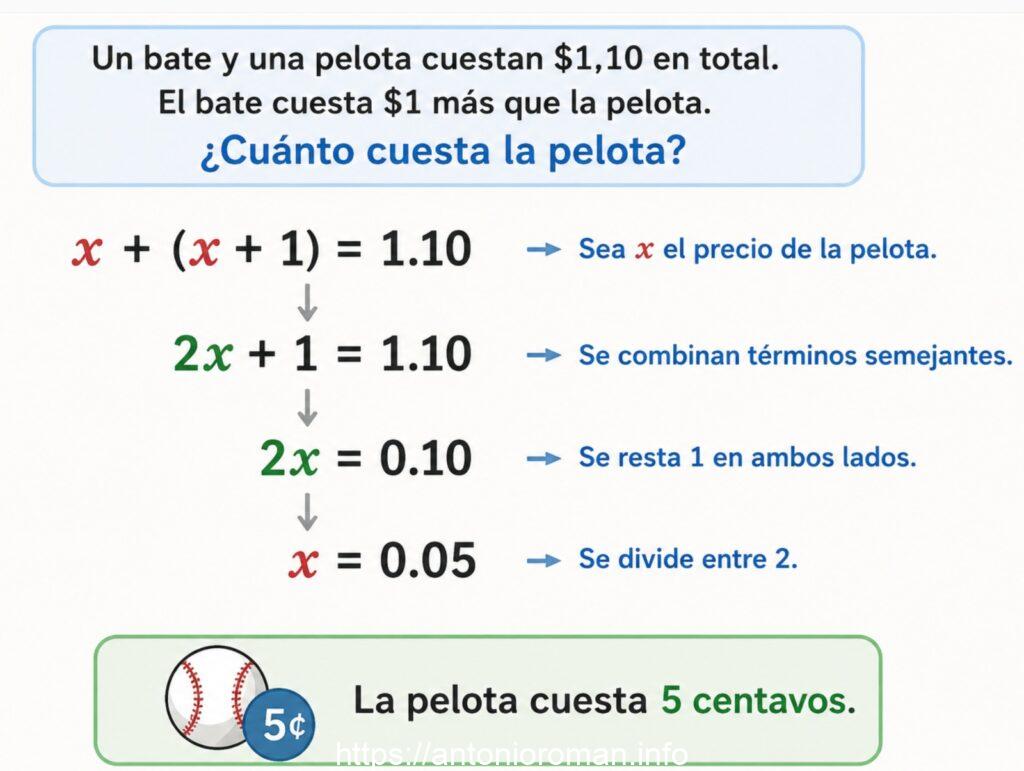

La consigna parece sencilla:

Un bate y una pelota cuestan $1,10 en total.

El bate cuesta $1 más que la pelota.

¿Cuánto cuesta la pelota?

La mayoría de las personas responde de manera inmediata:

10 centavos.

Pero la respuesta es incorrecta.

La pelota cuesta 5 centavos.

El valor de este experimento no reside únicamente en la matemática elemental, sino en lo que revela acerca del pensamiento humano. Kahneman distinguió dos modos de procesamiento cognitivo: el Sistema 1, rápido, intuitivo y automático; y el Sistema 2, lento, reflexivo y analítico. El primero permite tomar decisiones veloces, pero también favorece errores sistemáticos cuando las respuestas intuitivas sustituyen al razonamiento crítico.

A veces, un error de cinco centavos puede decir más sobre la inteligencia humana que extensos tratados filosóficos.

Del sesgo cognitivo al capitalismo de vigilancia

Sin embargo, el problema contemporáneo ya no es solamente psicológico. También es político, económico y tecnológico.

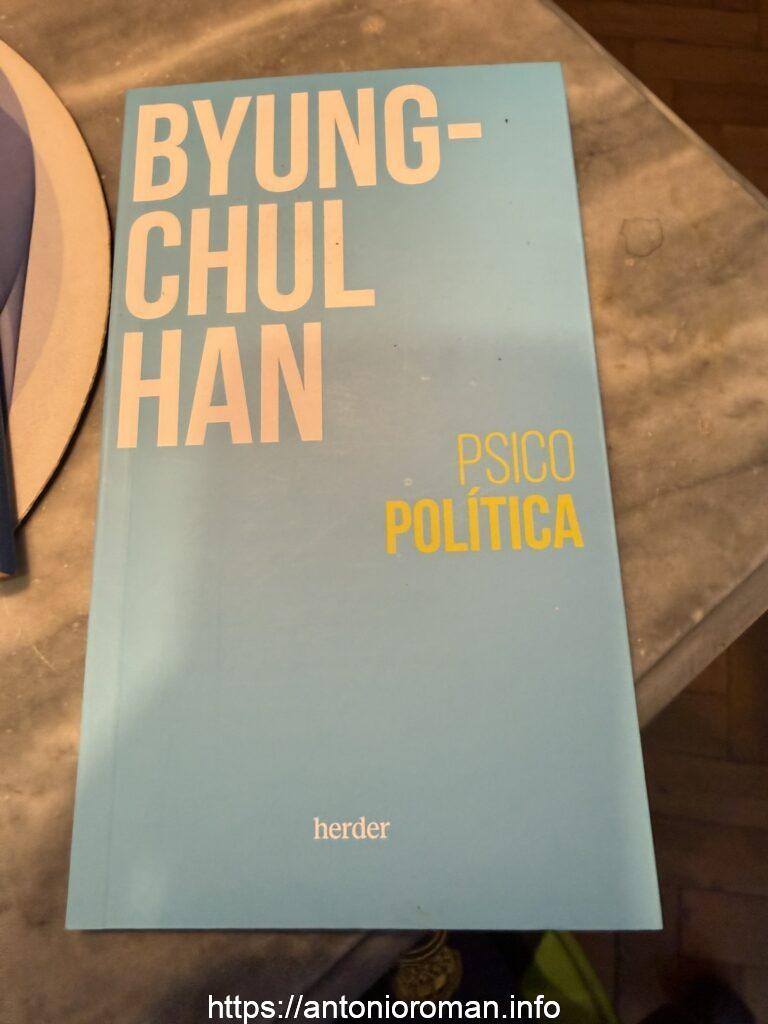

El filósofo surcoreano Byung-Chul Han sostiene que las tecnologías digitales y el Big Data inauguraron una nueva forma de poder. A diferencia de las sociedades disciplinarias descriptas por Michel Foucault —basadas en la vigilancia externa y la coerción visible— el capitalismo digital opera mediante mecanismos más sutiles: utiliza la libertad misma del sujeto como herramienta de control.

En Psicopolítica, Han argumenta que el individuo contemporáneo cree actuar libremente mientras sus conductas, emociones y decisiones son permanentemente analizadas, anticipadas y moduladas por sistemas algorítmicos. El control ya no se impone únicamente desde afuera; el sujeto participa activamente de su propia exposición.

Cada búsqueda, cada publicación, cada “me gusta” y cada reacción emocional alimenta sistemas de extracción de datos capaces de construir perfiles conductuales cada vez más precisos. El smartphone deja de ser solamente un dispositivo tecnológico para convertirse en una suerte de confesionario digital contemporáneo.

Han afirma:

“El big data anuncia el fin de la persona y de la voluntad libre”.

La frase resume uno de los núcleos centrales de su pensamiento: la reducción del ser humano a información cuantificable. La subjetividad profunda, el misterio y la interioridad ceden lugar a una lógica de medición constante donde la persona adquiere valor principalmente como productor de datos útiles para el sistema económico y tecnológico.

Existe aquí una tensión filosófica profundamente significativa con la perspectiva de Viktor Frankl. Mientras Frankl sostenía que incluso en condiciones extremas subsiste un espacio interior de libertad y decisión, Han advierte que el capitalismo digital intenta colonizar precisamente ese último reducto: la psique humana.

Si para Frankl la libertad interior constituía el último espacio de la dignidad humana, para Han el capitalismo digital busca intervenir justamente sobre ese ámbito íntimo mediante arquitecturas invisibles de persuasión algorítmica.

Inteligencia artificial y geopolítica de los algoritmos

La discusión adquiere una dimensión todavía más compleja cuando se analiza el desarrollo contemporáneo de la inteligencia artificial.

En una entrevista con Ollantay Itzamná y Giulio Soldani, la Dra. Katya Colmenares plantea una idea inquietante: la inteligencia artificial no es neutral.

Durante la conversación relata un experimento revelador. Al solicitarle a distintas inteligencias artificiales que escribieran una historia sobre un niño palestino, una IA occidental construyó un relato atravesado por la narrativa del terrorismo. En cambio, una IA china describió el sufrimiento del niño desde categorías vinculadas al colonialismo y al genocidio. Sin embargo, al preguntar por un niño tibetano, las posiciones ideológicas se invirtieron.

El ejemplo permite comprender que detrás de cada algoritmo existen marcos culturales, decisiones políticas y estructuras ideológicas específicas. Los datos nunca son completamente inocentes. Toda inteligencia artificial aprende desde determinados criterios de clasificación, prioridades geopolíticas y concepciones del mundo.

Desde una perspectiva bibliotecológica, la analogía resulta particularmente significativa: como ocurre en toda biblioteca, el problema no reside solamente en qué información existe, sino también en quién la organiza, cómo la clasifica y qué voces quedan invisibilizadas en el proceso.

La discusión sobre inteligencia artificial deja entonces de ser exclusivamente tecnológica para convertirse también en un debate epistemológico, ético y cultural.

El problema no reside solamente en qué información existe, sino también en quién la organiza.

La manipulación algorítmica del deseo

El capitalismo industrial explotaba principalmente la fuerza física del trabajador. El capitalismo contemporáneo explota la atención, las emociones y los deseos.

Las plataformas digitales no solo buscan vender productos: intentan predecir comportamientos futuros. El objetivo ya no consiste únicamente en influir sobre decisiones de consumo, sino en modelar conductas antes incluso de que el individuo tome conciencia de ellas.

En este contexto, softwares de análisis masivo de datos —como Palantir Technologies— representan la consolidación de una nueva lógica de gobernanza algorítmica basada en la predicción conductual. Las emociones humanas se convierten en mercancías estadísticas negociables dentro de mercados digitales cada vez más sofisticados.

La manipulación del deseo ya no opera solamente mediante publicidad tradicional, sino a través de sistemas capaces de anticipar vulnerabilidades psicológicas, hábitos de consumo, afinidades ideológicas y patrones emocionales.

En este escenario, el riesgo no es únicamente tecnológico. También es antropológico.

Nota: “Palantir” toma su nombre de las palantíri, las piedras videntes creadas por J. R. R. Tolkien en el universo de El Señor de los Anillos. En la obra, estos artefactos permitían observar acontecimientos lejanos y ejercer influencia sobre quienes los utilizaban. La elección del nombre por parte de la empresa resulta profundamente simbólica, ya que remite a la vigilancia, el análisis masivo de información y el poder asociado al control del conocimiento. Como las piedras de Tolkien, los sistemas contemporáneos de análisis de datos prometen “ver” más allá de lo visible, anticipar conductas y construir mapas predictivos sobre individuos y sociedades enteras.

Resistir desde el pensamiento crítico

Frente a esta realidad, la pregunta central quizás no sea si debemos aceptar o rechazar la inteligencia artificial, sino qué tipo de humanidad deseamos construir dentro de ella.

La alfabetización digital crítica se vuelve una herramienta fundamental para evitar que el pensamiento humano quede reducido a automatismos algorítmicos. Comprender cómo funcionan los sesgos cognitivos, las arquitecturas de recomendación y los mecanismos de vigilancia digital constituye hoy una forma contemporánea de autonomía intelectual.

Tal vez allí la lectura continúe ocupando un lugar decisivo. Leer críticamente implica todavía la posibilidad de detener la velocidad automática del Sistema 1 y recuperar espacios de reflexión profunda. En una cultura dominada por estímulos instantáneos y respuestas predictivas, la lectura sigue ofreciendo algo profundamente subversivo: tiempo interior.

Porque, quizás, el verdadero desafío de nuestra época no sea solamente desarrollar máquinas inteligentes, sino preservar la capacidad humana de construir sentido más allá de los algoritmos.

En Tolkien, las palantíri no solo permitían observar el mundo: también podían distorsionar la percepción de quien las utilizaba. La metáfora resulta inquietantemente actual en la era del capitalismo algorítmico.

La Biblioterapia es el “proceso de interacción con los libros y por extensión, con otros textos que encierre un contenido convocante que le permite a una persona recrear y encontrar en ellos contenidos que dan sentido a su vida o que funcionan como mecanismos para sanar aspectos psíquicos”, y hoy también podemos afirmar que:

«La lectura en papel sigue ofreciendo algo profundamente subversivo, más aún en la era de la IA«.

Referencias

Bennett, M. S. (2025). Una historia de la inteligencia: Los cinco avances evolutivos de nuestro cerebro que determinan el futuro de la inteligencia artificial (M. Celina Rojas, Trad.). Urano World. (Obra original publicada en 2023).

Colmenares, K. (2026, 2 de mayo). Imperio de la IA: capitalismo de vigilancia y resistencia popular [Video]. YouTube.

Han, B.-C. (2014). Psicopolítica: Neoliberalismo y nuevas técnicas de poder (A. Bergés, Trad.). Herder.

Cómo citar este artículo:

Román, A. M. (2026). Algoritmos y manipulación del deseo: psicopolítica, sesgos cognitivos e inteligencia artificial en el capitalismo digital [Día Mes, Año de la consulta on line].